2002�N�x�X�g�Y�L�O�����U�����

��

�����ۑ�u�����Ԃɂ����鎩���^�]�V�X�e�����M�����Ɋւ��錤���v

�c��`�m��w��w�@����E���f�B�A�����Ȍ�����m�ے�1�N

���{���v�@e-mail:mocchi@sfc.keio.ac.jp

�����ۑ�T�v

���݂̌�ʎЉ��������Ƃ��āC�����^�]�V�X�e���̕��y�����߂��Ă���D���ݕ��y�̖W���ɂȂ��Ă���M�������̉����̂��߂ɂ́C�����x�Ȋ��F�����K�v�ł���D�����Ŗ{�����ł́C�摜��������g�ݍ��킹�邽�߂́C�Z���T�t���[�W�����A���S���Y�����\�z�������^�]�V�X�e���̍��x�����s���D��̓I�ɂ́C�ԗ��ɃX�e���I�r�W�����ƁC���͊��f�[�^�x�[�X�i���͂ɑ��݂���Œ蕨�̂Ƃ��̌`��шʒu�Ɋւ���f�[�^�j�����C���̃f�[�^�x�[�X�𗘗p�����Z���T�t���[�W�����A���S���Y�����J������D�����xGPS�ɂ��ʒu�C���ʏ��C�X�e���I�r�W�����ɂ��摜���C���[�U�[���[�_�[����̏������͊��f�[�^�x�[�X��}��ɂ��ăZ���T�t���[�W�������s�����Ƃɂ��C�e�Z���T�̏��̐��x�����߁C���̃Z���T�ɑ��ăt�H���[�ł���V�X�e���̍\�z���s���D�{�����ł́C�V�~�����[�V�����C���Ԏ����ɂ��]�����s���D

�����̖ړI

�{�����ł́C���S�����^�]�V�X�e���ɂ����āC�摜���𗘗p���邱�Ƃɂ��C�����Ԃ̎��Ԉʒu�v���̐M��������ɉ����āC��Q�����o���\�����コ���邱�Ƃ�ړI�Ƃ��Ă���D�����xGPS�݂̂𗘗p�����C�ʒu���Ɉˑ������V�X�e���ł́C�q���̐M�����ߑ��ł��Ȃ����ꍇ���ɁC�傫�Ȉʒu�v���덷���������C�ڕW�R�[�X�����E���C�댯�ȏ���������D�܂��C���[�U�[���[�_�[�݂̂Ɉˑ�������Q�����o�́C�J�V���̌��o���\���啝�ɗ���D�܂��C���s�҂̕��̑f�ނɂ���ẮC���s�҂����o�ł��Ȃ��ꍇ������D���Ȃ킿�C��ʐl�팱�҂�ΏۂƂ����^�p���������S�ɍs�����߂̐M�������\���ł͂Ȃ��D�{�����ł́CCCD�J�����ɂ��X�e���I�摜���ƁC�����xGPS�ɂ��ʒu���C���[�U�[���[�_�[�̏�Q���ʒu�����I�ɏ������邱�Ƃɂ��C���Ԉʒu���o�C����я�Q�����o�Ɋւ���M�����̌�����s���D��̓I�ɂ́CCCD�J�����𗘗p�����C�摜���͑��u�C�摜�������u�𐧍삵�C�摜�����A���S���Y�����J������D�����āC���Ԏ����ɂ��]�����s�����̗L������]�������D

�{�N�x�̌�������

�{�N�x�̌������ʂɂ��ďq�ׂ�D�{�N�x�̐��ʂ́C�傫�������ĉ��L�̂R�_���s�����D

l

�c��`�m�V���^�E���L�����p�X�ɑ��݂��镨�̈ʒu�f�[�^�x�[�X�̍\�z

l

�摜�����𗘗p�������̔F���A���S���Y���̍\�z

l

�摜������z�肵�������^�]�]���V�~�����[�V�����v���O�����̍쐬

�P�ڂ́C�c��`�m�V���^�E���L�����p�X�ɑ��݂��镨�̏ڍʒu�f�[�^�x�[�X�̍\�z�ɂ��Đ�������D�摜�������玩�Ԉʒu����肷����@�́C���L�̂Ƃ���ł���D�܂��C�J�������瑗����f�����ʂ���ʏ�̒��ŁC���炩���ߌ��߂�ꂽ���̂�F�m����D����𗘗p���āC���̕��̂̉�ʏ�̈ʒu�C���̂̐�Έʒu���W�Ǝ��ԃp�����[�^(�����C���x��)���猻�݂̎��Ԃ̈ʒu���Z�o����D���̕��@�Ő��m�Ɏ��Ԃ̈ʒu�𐄒肷�邽�߂ɂ́C���̎��̂̐��m�̈ʒu���K�v�ł���D�����ł܂��C�V���^�E���L�����p�X�̐��������݂��镨�̂̒�����C�摜�F���̗e�Ր����l���ɂ���ēd���C�����C���a�C�Ŕ�I�����C���ꂼ��̐�Έʒu���W�i�ܓx�C�o�x�C�����j�̑�����s�����D�����̑���ɂ́C���݂̎����^�]�V�X�e���ɗ��p���Ă��鍂���xGPS��p�����D����ꂽ���茋�ʂ����ɂ��ꂼ��̈ʒu���v���b�g�������̂�}�P�Ɏ����D�܂��C����̗e�Ղɗ��p���邽�߂ɁC����̑���œ������̂̐��m�Ȉʒu�����f�[�^�x�[�X�Ƃ��č\�z�����D�{�f�[�^�x�[�X�́C��̉摜�����̍��������M�����C���Ƃɂ����Q���Ɨ\�����ʏ�Q���̌������邽�߂̐挩���₻����g�ݍ��킹�Ď��Ԉʒu�𐄒肷�邽�߂ɗ��p������̂ł���D

�}�P�@�V���^�E���L�����p�X�f�[�^�x�[�X�v���b�g�}

�}�Q�@���^�E���L�����p�X�̕��̈ʒu�f�[�^�x�[�X�\

�@�Q�ڂ́C��ʏ�̕��̈ʒu���ԍ�CCD�J�����ɂ��F�����邽�߂̉摜�F���A���S���Y���\�z�ɂ��Đ�������D�ԗ��ɓ��ڂ����J�����̉摜����蕨�̔F�m���s�����߂̃A���S���Y�����\�z�����D�摜�F���ɂ́CCCD�J�����C�摜�����p�{�[�h�Ɖ摜�����\�t�gHALCON���g�p�����D�摜�����{�[�h�Ƃ́CCCD�J��������̉f�����������Ƀp�\�R���ŏ������邽�߂̃n�[�h�E�G�A�ł���D�܂��CHALCON�͎�荞�摜��畨�̔F���̃A���S���Y���\�z��e�Ղɂ���\�t�g�E�G�A�ł���C�����^�]�v���O�������\�z����C����Ƃ̑��������ɂ悢���߁C�{�����ɂ����Ďg�p���邱�Ƃɂ����D

���ɁC�摜�F���A���S���Y���ɂ��Đ�������D�����C���a�͒n�ʂƕ��s�Ɉʒu���C�J��������̉f���ɂ����ĉ�ʂ̒�����艺�ɑ��݂��邱�Ƃ͖��炩�ł���D�܂��C���݂̎ԗ��p�����[�^�i�ʒu�C�������j�ɂ��f�[�^�x�[�X�����ʂɉf���o�����ł��낤�C�����C���a���s�b�N�A�b�v����D�܂������̐��m�Ȉʒu�f�[�^���C�J������蓾�����ʏ�ɂ����Ă̔����C���a�̔F���͈͂��߂邱�Ƃ��ł���D����ɂ��C�F�����x�̌���ƔF�����Ԃ̒Z�k���������Ă���D���l�ɁC�O���F���������悤�ɔ͈͂��w�肵�Ă���D�܂��C�͈͓��ɂ����ẮC�����C���a�C�O���͉��L�ɋL������ŔF�����s���Ă���D

�@

�摜�S�̂̏��i�P�x�C���ρC�����j��

�A

���݂̎ԗ��p�����[�^��O��̑��茋�ʂ��F���͈͂����肷��

�B

�F���͈͓��ɂ����āC�摜�̏����l������

�C

��L�̏������ɉ摜�̉��H�i�t�B���^�C2�l���C�G�b�W�����C�����߁j���s��

�D

���H���ꂽ�摜�ɂ����ăn�t�ϊ��C�p�^�[���}�b�`���O���s��

�E

�덷�̏��Ȃ����̂��̗p���F�����ʂƂ���

�F

�F�����ꂽ��ʏ�̈ʒu�����߂�

�G

���݂̎ԗ��p�����[�^��O��̔F�m�ꏊ�����l�����č���̔F�m�̗̍p�����肷��

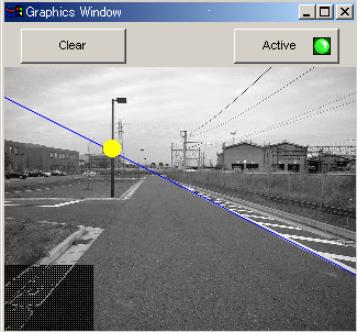

��L�̃A���S���Y����p���Đ}�R�Ɏ����摜�̏������s�������}�S�Ɏ����D�}�S�̐����́C�����̔F�m���ʂ������D�}3�̌��摜�Ɣ�r���Ĕ����̓����i�ԗ����j�ɉ����ĕ��s�ɕ`����Ă��邱�Ƃ������ł���D�}�S�̉��F���~�́C�O���̔F�m���ʂ������D�O���̒��S�ɉ~��������Ă���D�O���Ɋւ��ẮC���炩���ߊO���̃e���v���[�g�t�@�C����2��ޗp�ӂ��Ă����C���ꂼ��̃e���v���[�g�t�@�C���Ƃ̃}�b�`���O���s���C�������̂ł�����̂܂ܔF�m���ʂƂ��Ă���D�قȂ�ꍇ�ɂ����ẮC���덷�̏������ق���O��̔F�m���ʁC�ԗ��̃p�����[�^���l���ɂ���C���œK�Ȃ��̂��̗p���Ă���D�}�S�̍����̎l�p�ň͂�ꂽ���̂́C���a�̌��o�������Ă���D���a�́C�����Ɣ�r���ē��H�Ƃ̃R���g���X�g�����Ȃ��C�P���ȉ��H�i�Q�l���݂̂Ȃǁj��n�t�ϊ��݂̂ł͌��o���ɂ����D�����ŁC�P���Ȕ������o���@���s���Ƌ��ɁC���̐M��������̂��߂ɂ�����̕ʂ̕��@�ő��a�̌��o���s���Ă���D�܂��C���݂̎��Ԉʒu�ƑO��Ɍ��o�������a�̏ꏊ�����ʏ�̂�����x�̈ʒu�𐄒肷��D����ꂽ�����悻�̌��o�ڕW�ʒu����C�}�S�̂悤�Ɏl�p�`�̌��o�͈͂��쐬����D���̏��������o�͈͓��ɂ����āC�͈͓��ł̂Q�l���̂��߂�臒l�̌���C�z�[�����߁C���v���V�A���K�E�X�ɂ��G�b�W���o�ȂǑS�̂ōs���ɂ͔�r�I���Ԃ�L������l�X�ȉ��H��}�b�`���O���s���C���̑��a�̏ꏊ�����o����D���ɁC����̎l�p�`�ł͌��o���Ă��Ȃ������ɂ����āi�}�S�ł́C�����̎l�p�`�̉E��j�V�����l�p�`�̌��o�͈͂��쐬���C���l�ɑ��a�̌��o���s���D�����̌��o�𑤍a�̌��o�͈͑S�̂ōs���C���̌��o���ʂ����C���a���o��ʑS�̂ɂ����Ă̑��a�̌��o���x�����コ���Ă���D

�}�R�@�摜������i�摜�����O�j

�}�S�@�摜������i�摜������j

�R�ڂ́C�摜������z�肵�������^�]�]���V�~�����[�V�����v���O�����̍쐬�ɂ��Đ�������D���݊������Ă���L�����p�X�������^�]�V�~�����[�V�����v���O�����ɉ摜��������g�ݍ��킹�邽�߂̕]���p�V�~�����[�V�����v���O�������쐬�����D���݂܂łɎ����^�]�v���O�����́C�L�[�{�[�h�ŖڕW�ʒu��I������ƃM���̕ύX����ڕW�R�[�X�ɉ����ĖړI�n�܂Ŋ��S�����^�]���s������̂��������Ă����D�}�T�����̎��s��ʂł���D�}�̏㑤�������V���^�E���L�����p�X�̃}�b�v�ł���Ԃ��h��Ԃ����ۂ��ڕW�R�[�X�C�Ԃ�����݂̎ԗ��̈ʒu�ƌ�����\���Ă���D�܂��C���̐��͖ڕW�R�[�X�ƂȂ��Ă���C�����͂��ׂĐ�Έʒu�������Ƀv���b�g�����_�̏W���̂ł���D����̕ύX�_�́C���̂̈ʒu���f�[�^�x�[�X��g�ݍ��݁C�摜�����v���O�����ɂ��摜�������邱�ƂŁC�����^�]�̍��x����ڎw�����߂̕]����e�Ղɂ��邱�Ƃł���D��̓I�ɂ́C���݂̎ԗ��̈ʒu�C���������ɂ��ăf�[�^�x�[�X�Ɣ�r���C�f�[�^�x�[�X�ɑ��݂��镨�̂̒��ŃJ�����ɉf�肻���Ȃ��̂��s�b�N�A�b�v����D�Ⴆ�ΐ}�T�ł́C�ԗ��͐}�̉E����������ɑ��s���ł���D���̏ꍇ�C���Ԃ���������đO�����ɑ��݂���O���C�E���ɑ��݂��锒���C�����ɑ��݂��鑤�a���s�b�N�A�b�v�����D���R�C�����͘A���Ȃ��̂ł��肩���������݂��邽�߂��炩���߁C���������ɕ����������ɂ����Ă��̍œK�Ȃ��̂��s�b�N�A�b�v���Ă���D�܂��C�O���Ɣ��������l�ɂ��ăs�b�N�A�b�v���Ă���D�}�T�ł́C���F�̎l�p�ň͂܂�Ă���Ƃ��낪�C���݃s�b�N�A�b�v���Ă�����̂�\���Ă���D�}���ł��hgroove =149 light =102 white=121�h�Ƃ���C�����瑤�a�C�O���C�����̏��ɂȂ��Ă��肻�̐����ɂ́C��߂�ꂽ�ԍ��Ƃ��̕����ԍ����\���Ă���D�Ⴆ�C�hgroove�g�̏ꍇ���aNO9�̂S�Ԗڂ̕�����\���Ă���D����C�����s�b�N�A�b�v����Ȃ��ꍇ�́C�h�O�h��\������D�܂��C�{�V�~�����[�V�����v���O�����͂����̃s�b�N�b�v���ׂ����̂ƕ��̂Ɋւ������ʂ̉摜�����v���O�����ɑ��M�C�摜�����v���O��������摜�����̌��ʂ���M���邱�Ƃ��\�ł���D�V�~�����[�V�����v���O�����̊����ɂ��C�J�����ɂ��摜���Ƃ̐ڑ����@�C���M����������ڎw�����摜�F���]����{�����̍ŏI�ړI�ł��鎩�Ԉʒu�v���̌����@�����ɂ��Ĕ�r�I�e�Ղɍs�����Ƃ��ł���D

�}5�@�����^�]�V�X�e���V�~�����[�V�������s���

���N�x�̕]���y�э���̌v��

���N�x�́C�����^�]�V�X�e���̍��x����ڎw���āC

l

�c��`�m�V���^�E���L�����p�X�ɑ��݂��镨�̈ʒu�f�[�^�x�[�X�̍\�z

l

�摜�����𗘗p�������̔F���A���S���Y���̍\�z

l

�摜������z�肵�������^�]�]���V�~�����[�V�����v���O�����̍쐬

�̂R�̐��ʂ����߂邱�Ƃ��ł����D���N�x�́C���N�x�̐��ʂ𗘗p���āC�摜�����ɂ����F�����\����̃V�X�e���\�z�i�}�U�j�C�Z���T�t���[�W�����ɂ�鎩�Ԉʒu���M�������@�̌����i�}�V�j�C���Ԏ����ɂ��]�����s���Ă��������ƍl���Ă���.

���N�x�v��ʂ�ɐ��ʂ����߂邱�Ƃ��ł����̂́C�X�g�Y����̂������ł���C�����Ɋ��ӂ̈ӂ�\����D

�}6�@�摜�����ɂ����F�����\����̃V�X�e���\�z

�}7�@�Z���T�t���[�W�����ɂ�鎩�Ԉʒu���M�������@�̌���